AIgeist numero 10 speciale AI Act UE: cosa cambia, quando e come │I tool utili per navigare e decidere│ Cosa fanno gli altri │ Sondaggio: partiti col piede giusto?

Benvenuti in AIgeist, la newsletter settimanale che parla semplicemente di AI.

Ogni mercoledì alle 7. Le altre nostre newsletter: Finambolic (martedì), Xerotonina (giovedì)

Il tema è - AI ACT, risorse utili

Prima di inoltrarci nei meandri dell’AI act facciamo un po’ di ordine. Pochi giorni fa un think tank statunitense ha prodotto un report, pagato dal governo, dove si parla direttamente di “rischio di estinzione dell’umanità” se l’AI viene usata in modo scorretto (qui l’intera ricerca in PDF). Un simile, ma assai meno catastrofista, paper cinese ha fatto molto discutere dalla sua pubblicazione nel novembre del 2023 (qui ne trovate copia e qui le politiche europee e cinesi di controllo sull’AI a confronto).

Le iniziative di regolamentazione globale, dalla sfilata di leader e capi di Stato a Londra lo scorso novembre fino all’apertura di un canale bilaterale di comunicazione tra Pechino e Washington deciso da Xi Jinping e Joe Biden negli stessi giorni, la dicono lunga sulla pressione che il settore sta sentendo.

Ma alla fine, nonostante la sua posizione minoritaria tecnologicamente e industrialmente (vedi AIgeist numero 6), la prima mossa l’ha fatta l’Unione Europea.

Ma allora, cos’è questo AI ACT? Il regolamento sull'intelligenza artificiale (AI), approvato il 13 marzo dal Parlamento europeo, dopo due anni di lavoro e dibattiti parlamentari (e lobbistici), si compone di 113 articoli, XIII allegati e più di 450 pagine (qui la versione completa in italiano del testo approvato). Ha l'obiettivo di promuovere un'IA affidabile in Europa e oltre, garantendo che i sistemi di AI rispettino i diritti fondamentali, la sicurezza e i principi etici della UE. Il prerequisito, si legge nel documento, è che l'AI dovrebbe essere una tecnologia antropocentrica, cioè uno strumento affidabile che ha come fine il benessere degli esseri umani. Questa la descrizione degli intenti dell’AI ACT che viene definita dalla commissione europea il “il primo quadro giuridico in assoluto in materia di AI, che affronta i rischi e posiziona l'Europa a svolgere un ruolo di primo piano a livello globale”.

Il monumentale documento, che ha ricevuto 523 voti favorevoli, 46 contrari e 49 astenuti, dovrà passare al vaglio finale dei giuristi-linguisti e dovrebbe essere adottato definitivamente prima della fine della legislatura verso maggio. Entrerà però in vigore venti giorni dopo la pubblicazione nella Gazzetta ufficiale dell'UE e inizierà ad applicarsi in toto 24 mesi dopo l'entrata in vigore. È previsto però un calendario differenziato per i divieti relativi a pratiche vietate, che si applicheranno a partire da sei mesi dopo l’entrata in vigore; i codici di buone pratiche (nove mesi dopo); le norme sui sistemi di IA per finalità generali, compresa la governance (12 mesi) e gli obblighi per i sistemi ad alto rischio (36 mesi).

Poi ci saranno gli atti che ogni singolo paese membro dovrà intraprendere per “calare” la regolamentazione nel proprio contesto giuridico, e non possiamo aspettarci altro che una battaglia sul suolo delle singole leggi nazionali (vedi sotto per ulteriori risorse sul tema).

NAVIGARE NELL’AI ACT

Tra le risorse per navigare all’interno dell’AI ACT consigliamo, per iniziare, Euaiact.com dove il testo (in inglese) è organizzato in parole chiave e dotato di un motore di ricerca per facilitarne la lettura e la comprensione. Il sito è stato creato da Emre Kazim, esperto di Ai e governance per il Comitato sull'intelligenza artificiale (CAI) del Consiglio d'Europa e per l’ONU, che è anche fondatore di Holistic AI, una start-up focalizzata sul software per l'auditing e la gestione del rischio dei sistemi di intelligenza artificiale.

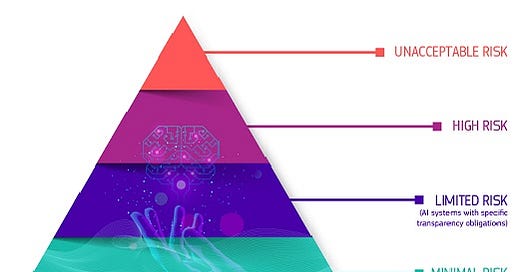

LA PIRAMIDE DEL RISCHIO

L’AI Act prevede una definizione dei rischi all’interno della quale rientrano diversi usi di queste tecnologie. Per ogni tipologia di “rischio” in cui rientra l’uso di un’AI, ci sono regole diverse. La piramide le rischio è la seguente:

Inaccettabile: pericoloso per le persone;

Elevato: può avere impatti negativi sulla sicurezza delle persone o sui diritti fondamentali (come l’identificazione biometrica in tempo reale e a distanza) Limitato deve rispettare requisiti minimi di trasparenza per consentire alle persone di prendere decisioni informate;

Minimo o nullo si riferisce ad applicazioni come videogiochi abilitati per l'AI o filtri antispam. La stragrande maggioranza dei sistemi di AI attualmente utilizzati nell'UE rientrerebbero in questa categoria.

Questa piramide diventerà centrale e la troveremo ovunque, tanto vale metterla a mente:

Ma quanto sarà difficile per un’azienda capire se le attività che sta intraprendendo cadono in questa o quella fascia di colore? Noi vi segnaliamo due risorse per affrontare il tema

La prima è un documento scientifico realizzato dal nostro Luciano Floridi et al. che mette le basi di un sistema di misurazione e assesment delle attività di ogni operatore. Nasce all’interno del Digital Ethics Center, University of Bologna- Department of Legal Studies, un’eccellenza in tal senso.

Per chi invece cerca qualcosa di più semplice ma anche più approssimativo segnaliamo questo tool realizzato da privati e battezzato EU AI Act Compliance Checker. Si tratta di poche e semplici domande e la risposta è immediata ma inevitabilmente contiene un “likely” che la rende soggetta a ulteriori approfondimenti. Ma meglio di niente.

Dopo le importanti polemiche delle lobby tech, e di intere nazioni, avvenute nel rush finale per ora non si sono ancora alzate grida di guerra contro l’Act, che è stato molto emendato

Ma ripetiamo, manca ancora probabilmente una immediatezza di strumenti per capire se le aziende possono e come allinearsi a questo schema regolamentare, e a quale prezzo. Terremo d’occhio il tema e leggiamo di commenti “bittersweet” in qualche articolo di giornale.

LA VOCE DEI CONSUMATORI E LA PRIVACY

D’altra parte quello che è certo è che i consumatori si aspettano mosse decise per proteggere gli utenti dai rischi, e hanno un atteggiamento cauto ma sostanzialmente benevolente verso questa tecnologia, come ben spiega questo report dedicato al tema. La fonte è un ente di ricerca sulla privacy, e forse non a caso emerge che una delle prime preoccupazioni dei consumatori è proprio la riduzione della stessa tramite tool AI (vedi schema sotto).

Su questo aspetto specifico ci siamo fatti aiutare proprio da ChatGPT4 per estrapolare i passaggi dedicati al tema privacy nell’ACT ufficiale. Non abbiamo abbastanza spazio per riportarli tutti qui, ma due ci hanno impressionato:

Diritti degli interessati: Gli utenti hanno diritto di accedere, rettificare, cancellare i loro dati personali o limitarne il trattamento in contesti AI, in linea con i diritti garantiti dal GDPR.

Trasparenza e diritto di spiegazione: Gli utenti hanno il diritto di essere informati in modo chiaro e comprensibile se stanno interagendo con un sistema di AI, oltre a ricevere spiegazioni sui meccanismi decisionali dei sistemi di AI, specialmente quando questi hanno un impatto significativo sui diritti individuali

Non c’è dubbio che siamo davvero all’inizio di un lungo cammino, e che nel frattempo intere mandrie di buoi abbiano già lasciato il recinto e pascolino liberamente pascendoci con i nostri dati.

Da ricordare in breve> L’Europa ha bruciato tutti sul tempo e ha pubblicato un importante atto di indirizzo per regolamentare lo sviluppo e l’uso delle piattaforme di AI, includendo la protezione dei dati personali che è un cavallo di battaglia dell’UE, dai tempi del GDPR. Ora l’industria e i cittadini devono digerire l’ampia stesura e calarla nella realtà dei fatti. Mancano ancora tool pratici per arrivare dritti al punto su questi temi, ma molti operatori anche privati vi stanno dedicando ingenti risorse.

La risorsa è - Il tracker globale per essere aggiornati sulle leggi che cambiano

Chiudiamo questo speciale tornando al tema di partenza: l’UE è stata la prima, ma moltissime nazioni stanno normando l’AI. A questo link trovate la migliore fonte, sempre aggiornata, sullo stato di queste regolamentazioni, e i documenti relativi. Dall’Argentina agli United States!

🔗 Link: Global AI Law and Policy Tracker

🪙Prezzo: per i professionisti che vogliono operare con una certificazione rilasciata dall’International Association of Privacy Professionals (IAPP) l’organizzazione senza scopo di lucro che contribuisce a definire, promuovere e migliorare la privacy a livello globale, è necessario fare un corso a pagamento