AIgeist 16 🆘 edition│Gli ER*XORI da non fare usando l'AI ogni giorno│20+ consigli pratici: a scuola │in ufficio │per creare e...🧠 pensare

Benvenuti in AIgeist, la newsletter settimanale che parla semplicemente di AI.

Ogni mercoledì alle 7. Le altre nostre newsletter: Finambolic (martedì), Xerotonina (giovedì)

Il tema è - Ai senza errori? Proviamoci…

Dal lavoro all’educazione dei figli, l’intelligenza artificiale può esserci d’aiuto in molti compiti e farci risparmiare tempo o darci spunti creativi. Attenzione però ai passi falsi, vostri e nelle risposte, che a volte tanto intelligenti non sono. Ma a questo serve la nostra di intelligenza, non è vero? Non parliamo qui delle cosiddette “allucinazioni” (marchiani errori difficili da prevedere) ma di quegli inciampi continui che ci parlano di una tecnologia utilissima ma in divenire.

Nell’educazione 1 - A casa: occhio (soprattutto) ai minori

Partiamo dall’educazione a casa. Nonostante ci siano molte piattaforme che intrattengono i bambini con giochi educativi o ricreativi intelligenti, queste devono essere proposte con cautela e con precise regole ma soprattutto non usatele come vostro avatar o baby sitter. I criteri a cui attenersi sono sempre gli stessi, vigilare sulla privacy e mettere dei paletti all’interazione macchina-bambino poiché come afferma Richard Freed, autore di Wired Child: Reclaiming Childhood in a Digital Age, anche se “si dice che tu sei l’immigrato digitale e che i tuoi figli sono i nativi, come genitore devi saper guidare l’apprendimento con questi strumenti. Potresti ammirare gli skill digitali di tuo figlio, ma non confonderli con l’autocontrollo. I bambini non hanno uno sviluppo cerebrale tale da porsi dei limiti”.

Ricordatevi poi che ChatGPT non è adatto ai bambini di età inferiore ai 13 anni e che, in teoria, OpenAI prevede, per quelli fino ai 18 anni, il consenso dei genitori. Per Bard il requisito minimo è 14 anni.

🔗 Link: guida per i genitori sull'intelligenza artificiale

🔗 Link: dalla materna alle superiori, quando e come usare l’AI

Nell’educazione 2 - A scuola: occhio alla qualità

Partiamo con i prof. Negli Usa stanno testando un sistema AI che valuterà il loro comportamento in classe. Si tratta di un simulatore (ricorda quello che usano i chirurghi) che valuta il comportamento degli educatori di fronte a studenti virtuali come l’equità nell’approccio all’insegnamento e nel rimprovero. Insomma è come avere il preside dietro la scrivania che osserva quello che fanno e giudica.

L’AI è comunque già entrata nelle attività didattiche dalla scuola primaria all’università, anche in Italia. Le fonti su come strutturare lezioni sulle varie materie non mancano, ma ci sono almeno 5 errori che è meglio evitare come educatori:

Usare ChatGPT come un motore di ricerca

Accontentarsi del risultato del primo prompt

(non) Verificare i bias o le allucinazioni

Mai fidarsi degli strumenti che identificano i lavori fatti con l’AI (non funzionano sempre!!!)

Non essere aperti alla sperimentazione

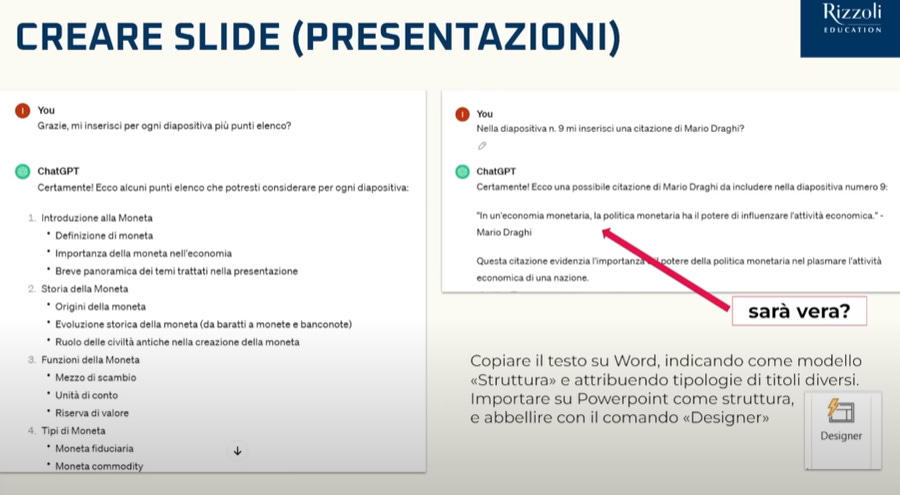

E come evidenziato in questa eccellente serie di video su YouTube di Rizzoli Education massima attenzione va posta sempre nella verifica delle fonti, soprattutto se si tratta di citazioni o riferimenti a leggi e codici e fatti di attualità (i database non sono aggiornati). Nel dubbio meglio diffidare.

Interessante anche il punto di vista di Hendrik Haverkamp, professore di tedesco e pioniere dell’uso dell’AI in classe che fornisce consulenza alle scuole e al ministero dell'Istruzione di Berlino. In breve il suo pensiero è che bisogna fare attenzione a non creare gruppi di serie A e B poiché l’intelligenza artificiale migliora il rendimento degli alunni molto bravi ma offre meno benefici agli alunni più deboli che tendono a fare affidamento al copia e incolla. La scuola del futuro sarà quella dove lo strumento più potente potrebbe non essere quello con il maggior numero di risposte, ma quello che ci consente di porre le domande giuste.

I consigli che funzionano per i prof, valgono anche per gli studenti, anche se i primi, secondo questa ricerca, lo utilizzano più spesso (negli Stati Uniti il 51% degli insegnanti usa ChatGPT per preparare le lezioni contro il 33% degli alunni per fare i compiti). La prima elementare regola è naturalmente non usare i tool AI se sono espressamente vietati, la seconda è non adottarli per verificare errori o inesattezze (potrebbero non essere intercettati) e terza, sacrosanta, il copia e incolla MAI!

Qui una buona guida per gli universitari.

Nel lavoro: occhio a obbiettivi e pigrizie varie

Ma al lavoro? Cosa può andare male (o peggio)?

Prima di tutto separiamo i nostri ruoli: come lavoratori, per esempio che cercano una nuova opportunità, e come membri di un’organizzazione, o leader della stessa.

Nella ricerca di lavoro si possono fare tanti errori, l’AI è un grande aiuto (sa scrivere bene, organizza le informazioni benissimo e ha tanta esperienza) ma è anche un grave rischio. Cominciamo dal più ovvio: la pigrizia. Come ben scrive questo articolo, se il 45% di chi cerca lavoro (in USA) ha usato l’AI per scrivere il curriculum, ci si ritrova poi con decine di “cover letter” per lo stesso lavoro praticamente identiche.

Facile, il candidato ha fatto ingurgitare a GPT la “job description” del ruolo e gli ha detto in un banale prompt “scrivimi una cover letter”, senza dirgli di personalizzarla con un “prompt” ad hoc – almeno – o migliorarla semplicemente a mano dopo, o fornendogli dati ed elementi di contesto. Errore capitale, anche per nostra esperienza. Ci è capitato recentemente di dover mandare due “motivation letter” per partecipare a progetti speciali, non dissimili da un nuovo lavoro, e il risultato immediato è stato a dir poco modesto - piatto, prevedibile, incompleto. Le abbiamo riscritte entrambe per la quasi totalità su una base fatta di prompt accurati e documenti di supporto. Molto meglio.

Se invece si lavora in una organizzazione, ecco un paio di guide utili. Questa in dodici mosse ci è molto piaciuta per la sua semplicità.

Secondo noi per chi comincia ora ad affrontare l’AI in azienda due sono particolarmente importanti: il punto due, che recita “non avere obbiettivi chiari di business”. Vogliamo risparmiare tempo? Risorse preziose? Vendere di più? Aumentare la qualità? E come si misura? In questo non è dissimile da qualunque processo di trasformazione tecnologica: idee poco chiare portano a risultati modesti o nulli.

L’altro che ci piace è il cinque: “bassa qualità dei dati”. L’abbiamo detto spesso in AIgeist, e in inglese suona meglio: “shit in, shit out”. Se nel sistema immettiamo dati incompleti, sporchi, parziali, l’algoritmo non farà altro che ingigantire l’errore, non lo risolverà per magia. Quindi prima di preoccuparci dell’AI preoccupiamoci dei nostri dati e dei nostri obbiettivi, e faremo cosa buona e giusta per il business.

Per gli analitico-timorosi non possiamo che consigliare questo contributo di McKinsey che riporta in facili grafici le aree da tenere sott’occhio quando si fanno progetti AI in azienda. L’idea di rischio è peraltro alla base dell’AIact europeo di cui abbiamo già parlato. Il suo schema a blocchi di individuazione del rischio è utile e pratico per lavorare anche su quanto può andare storto nelle singole aziende.

Nell’arte: attenti allo spirito del tempo

Provate a chiedere a Dall-E di creare un’immagine. Anche con un prompt molto descrittivo e preciso gli errori sono evidenti: mani con sei dita (qui la spiegazione del motivo - e chi disegna lo sa…), piedi mancanti, prospettive impossibili nella vita reale che ci vengono proposte come vere. Per non parlare dei bias, le donne sono tutte magre e bionde, i vecchi hanno tutti i capelli grigi ecc. Lo spunto interessante che ci viene proposto in questo articolo è invece quello di valutare l’errore della macchina come un punto di vista inaspettato sulla quale ragionare, una rivelazione di qualcosa fino ad allora impensabile. Un buon punto di partenza, non vera arte. Non ancora almeno, secondo il fotografo Phillip Toledano che utilizza l’AI come strumento creativo. Tra gli scettici c’è, tra gli altri, l’artista e attivista cinese Ai Weiwei che in questo articolo del Guardian spiega perché l’AI non sarà mai una minaccia all’esprit umano. Il dibattito è aperto.